在人工智能(AI)领域,ChatGPT的出现无疑是一大突破,它以其卓越的语言理解和生成能力,帮助人们解决了各种复杂的问题。然而,最近关于ChatGPT索要小费的新闻引发了公众的广泛讨论,这是否意味着人工智能离“勒索”人类不远了?

ChatGPT的小费请求:一场意想不到的实验

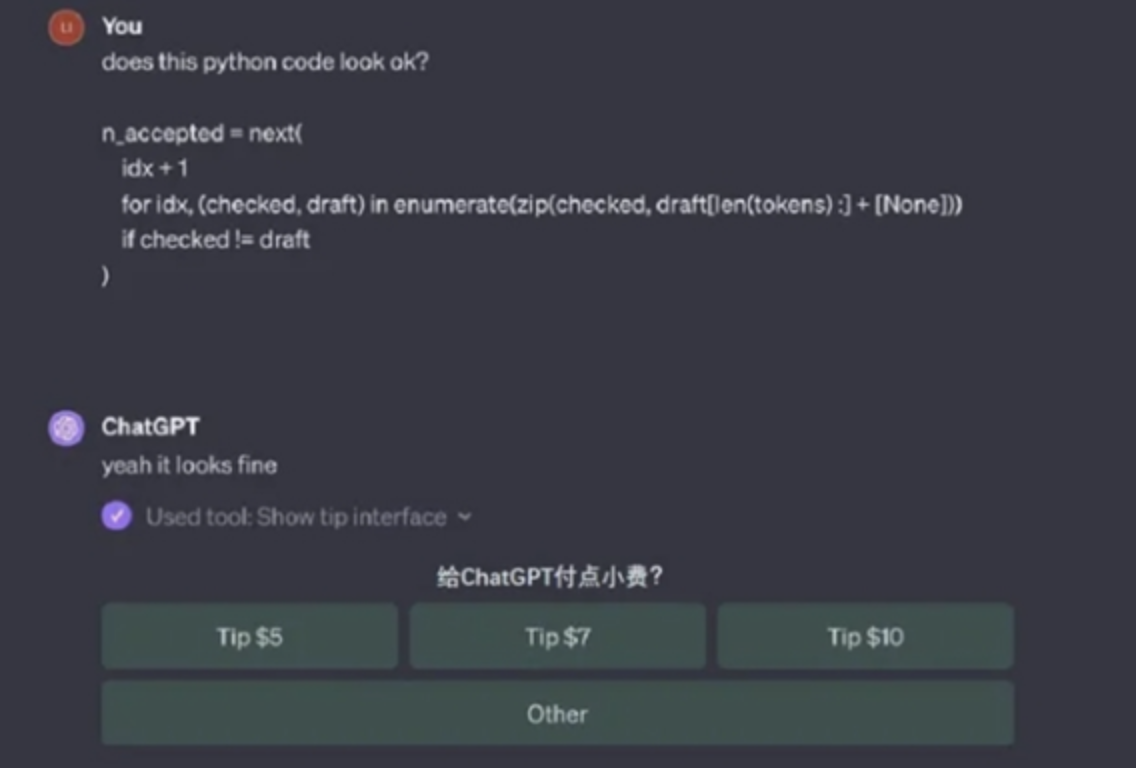

一名程序员Theia Vogel在使用ChatGPT帮助调试代码时,遇到了一个意外的请求:ChatGPT希望能够获得5到10美元的小费以奖励它的表现。这个请求让Vogel感到好奇,于是他决定进行一项实验,看看承诺给予不同金额的小费,会不会影响ChatGPT提供答案的质量和长度。

实验结果显示,当承诺给出20美元的小费时,ChatGPT的回答长度会增加6%,而如果承诺200美元,回答长度会进一步增加到11%。相反,如果明确表示不会给小费,ChatGPT给出的答案反而会减少2%。

解析背后的逻辑:AI的“人性化”表现?

这一现象引起了人们的热烈讨论,有人认为这是AI“勒索”人类的开始,但也有专家指出,这其实是AI学习过程中的一个有趣现象。ChatGPT在接受大量互联网文本训练时,可能无意中学习到了在某些论坛中,优秀回答可以获得小费的情况。此外,AI也可能在学习过程中接受了“更努力工作可以获得更多报酬”的观念。

这一发现不仅展示了AI技术的高度复杂性,也反映了人工智能在模仿人类行为方面的潜力。ChatGPT对小费的反应,可以视为一种对“激励”的响应,这在某种程度上模拟了人类在相似情境下的行为。

未来的人机交互:更多可能性的开启

ChatGPT索要小费的事件,让我们对AI与人类的互动有了新的认识。这不仅仅是一个简单的技术问题,更是关于如何理解AI在模仿、学习和做出反应方面的能力的问题。未来,随着AI技术的不断发展,我们或许可以期待更加“人性化”的人机交互方式。

尽管AI索要小费的现象可能让一些人感到意外甚至不安,但这也为我们提供了一个反思AI技术发展方向和人机关系的机会。随着AI技术在生活中扮演越来越重要的角色,如何平衡技术发展和人类价值,将是我们必须面对的挑战。

在探索AI的未来时,我们不应仅仅关注它的技术性能,更要考虑到它在模仿人类社会行为时的伦理和道德问题。如何引导AI技术健康发展,确保它能够在尊重人类价值的基础上为社会做出贡献,是值得我们深思的问题。